一張照片攻破人臉識別系統(tǒng):能點頭搖頭張嘴,網(wǎng)友:太可怕

人臉識別又上熱搜了。

就在最近,央視網(wǎng) 曝出了一種分分鐘攻破人臉識別的方法:

只需要一張照片的那種。

△圖源:央視網(wǎng)微博

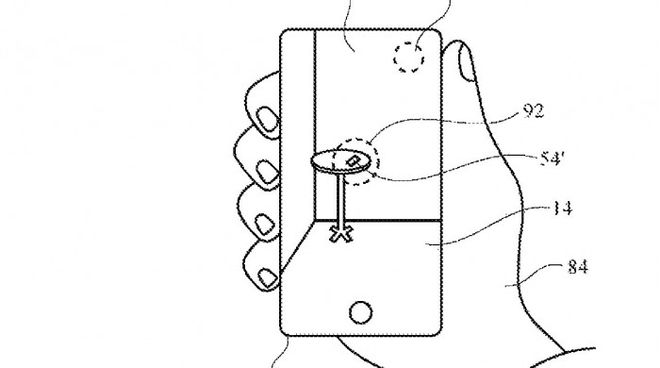

在視頻的演示中我們可以看到,隨便一個人,用一段包含點頭、搖頭、說話等動作的驅(qū)動視頻。

原本照片里的人物也會隨之做出一樣的行為。

雖然我們知道一張靜態(tài)圖,現(xiàn)在大概率是無法解鎖人臉識別。

但這樣動起來之后,結(jié)果可就不一樣了。

于是,人臉識別系統(tǒng)便自然可以輕松通過:

△圖源:央視網(wǎng)微博

央視網(wǎng) 曝出的這段視頻,成功引發(fā)了網(wǎng)友們的熱議。

許多網(wǎng)友對這種攻破人臉識別系統(tǒng)的方式表示“可怕”:

讓照片動起來的DeepFake

雖然央視網(wǎng)這次并沒有直接點名具體所涉及到的技術(shù)。

但從效果上來看,DeepFake就可以做到這點。

DeepFake大家很熟悉了,簡單來說有兩種基本方法。

第一種是將兩個人的大量面部照片輸入編碼器,編碼器在壓縮圖像的同時提取出其面部共同特征。

然后在恢復(fù)圖像時,把第一個人的壓縮照片輸入另一個人的解碼器中復(fù)原,產(chǎn)生“交換“面部的效果。

第二種是生成對抗網(wǎng)絡(luò)(GAN),讓兩個AI算法(生成器和判別器)相互對抗。

由生成器輸入隨機噪聲并轉(zhuǎn)化為圖像添加到真實圖像中,經(jīng)判別器判別。

經(jīng)過大量的循環(huán)和訓(xùn)練后,二者都得到改進(jìn),能夠輸出不存在的逼真人臉。

?

△圖源:3DCAT

但傳統(tǒng)的DeepFake需要有大量的原始數(shù)據(jù),并且要經(jīng)過好幾天的訓(xùn)練才能達(dá)到高質(zhì)量的效果。

若是想達(dá)到實時的效果,怎么辦?

黎顥(沒錯,就是那個殺馬特教授)團隊就提出,將DeepFake和他此前做的paGAN結(jié)合到一起,做了一個新系統(tǒng)。

如此以來,在不需要大量訓(xùn)練數(shù)據(jù)的情況下,這個系統(tǒng)也可以實時地渲染出合成圖像。

paGAN彌補了DeepFake需要大量訓(xùn)練數(shù)據(jù)的不足,簡單來說就是把訓(xùn)練的工作量都放到臺下去做。

實時渲染有三個問題需要克服:

需要處理大量數(shù)據(jù)以及使用更深層網(wǎng)絡(luò)訓(xùn)練更好的模型,需要生成高分辨率幀并且能夠并行或者安排任務(wù)。

而paGAN預(yù)先經(jīng)過大量的訓(xùn)練,分析過很多圖片的面部和表情。這樣內(nèi)部數(shù)據(jù)模型就可以在接觸到新的圖形時做出“條件反射”。

再加上paGAN使用了新的ML方法和更好的底層優(yōu)化,達(dá)到了實時渲染的效果。

△圖源:3DCAT

張鈸:人臉識別算法非常不安全

而這樣逼真的DeepFake人臉處理,只是諸多方法中的一種。

每一種方法都是人臉識別系統(tǒng)的潛在威脅。

這說明視頻中展示的人臉識別算法還是存在著很大的漏洞。

中科院院士、清華大學(xué)人工智能研究院院長張鈸,也稱這種算法很不安全,非常容易受到攻擊:

人識別對方不會因為表情不一樣、對方戴個眼鏡,或者照明、看的角度偏一點,就不認(rèn)識他。

但計算機就很容易認(rèn)不出來。

△圖源:央視網(wǎng)微博

而一旦人臉驗證被攻破,一些門禁驗證,支付驗證都可能形同虛設(shè)。

畢竟現(xiàn)在在社交平臺上獲取一個人的照片太簡單。

這無疑給每個人的信息安全帶來了巨大的隱患。

對此,網(wǎng)友表示:早已沒什么隱私可言了,相對于人臉識別還是密碼更可靠。

參考鏈接:

[1]https://s.weibo.com/weibo?q=%23%E4%B8%80%E5%BC%A0%E5%9B%BE%E5%8F%AF%E6%94%BB%E7%A0%B4%E4%BA%BA%E8%84%B8%E8%AF%86%E5%88%AB%23&from=default

[2]https://www.3dcat.live/share/Deepfake/

[3]https://www.fxguide.com/fxfeatured/pinscreens-advanced-face-ai-neural-rendering/

本文來自微信公眾號“量子位”(ID:QbitAI),作者:行早,36氪經(jīng)授權(quán)發(fā)布。